| 일본 유명 프로중 PLAYZONE이라는 프로가 있다.

슬램덩크의 채치수를 연상케 하는 키큰 아저씨가 바로 사회자인데,

입담이 좋아 프로그램을 오랫동안 진행했다고 한다.

우리나라로 치면 젊음의 행진 내지는 가요톱텐 비스무리한거라고나 할까?

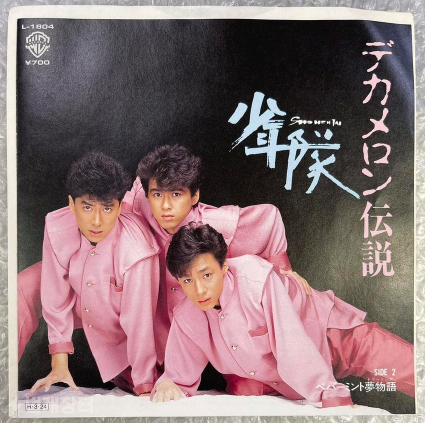

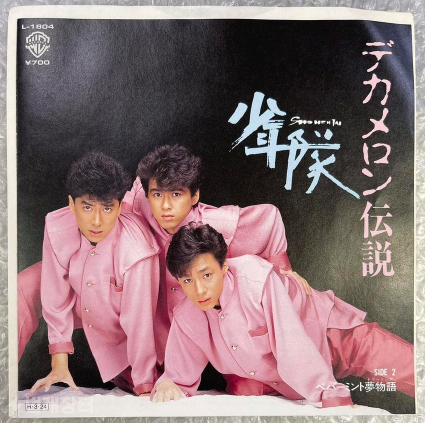

여기서 소년대가 부른 노래...

데카메론 전설

오래된 영상이라 좀 어설픈면도 있지만,

당시 일본 소녀들의 가슴을 뭉클하게 만들었던 꽃미남 3인방 소년대의 현란한 무대~

아래 영상에서 방송사고로 한명의 마이크는 제 기능은 못했지만… 훌륭한 라이브 공연을 감상하실 수 있습니다. 夜の都会は 恋の砂漠

高層ビルは遠い山脈

ながい睫毛(まつげ)の 君の瞳

南に浮ぶ星のようだね こぼれてく 時の砂

時代が変わっても

恋人は見つめ合って

伝説を作るよ AH- デカメロン (恋物語)

AH- デカメロン (千夜一夜さ)

AH- 10日間だけじゃ

語れやしない 愛している (君だけ)

狂おしいくらい (君だけ)

離さない

Oh, I need

YOU! YOU! YOU!

神に誓うよ 窓の向こうに 浮ぶシルエット

ラクダに乗った旅人達

赤や緑の ネオン管に

街は まるで 白夜みたいさ Find more lyrics at ※ Mojim.com

鮮やかな 夢の色

過去から未来へと

僕達が 接吻(くちづけ)れば

ロマンスが生まれる AH- デカメロン (恋物語)

AH- デカメロン (千夜一夜さ)

AH- 男(おとこ) 女(おんな)

悲劇に喜劇 守ってやる (君だけ)

永遠(とわ)にいつまでも (君だけ)

真剣さ

Oh, I need

YOU! YOU! YOU!

ついておいでよ Love Me True

Never Leave Me Alone AH- デカメロン (恋物語)

AH- デカメロン (千夜一夜さ)

AH- 10日間だけじゃ

語れやしない 愛している (君だけ)

狂おしいくらい (君だけ)

離さない

YOU! YOU! YOU!

神に誓うよ

Tags: デカメロン伝説 デカメロン伝説 Lyrics デカメロン伝説 가사 少年隊 데카메론 전설 데카메론 전설 가사 방송사고 소년대 일본아이돌

|  1,303

1,303  0

0  0

0  0

0  31395

31395